ASCII, que significa American Standard Code for Information Interchange (Código Estándar Americano para el Intercambio de Información), es un sistema de codificación de caracteres que se utiliza para representar texto en las computadoras, dispositivos electrónicos y otros equipos que manejan texto. Este sistema asigna valores numéricos a los caracteres, lo que facilita su almacenamiento y transmisión de manera digital.

Desde su creación en 1963, ASCII se ha convertido en uno de los sistemas más importantes y fundamentales para la codificación de datos, y aunque se han desarrollado nuevas y más complejas codificaciones (como Unicode), ASCII sigue siendo esencial en muchos entornos de programación y tecnología.

Historia de ASCII

ASCII fue desarrollado por un comité encabezado por Robert W. Bemer en la década de 1960. En sus primeros días, el código fue utilizado para estandarizar el intercambio de información entre diferentes dispositivos de telecomunicaciones. Antes de la creación de ASCII, cada fabricante de dispositivos tenía su propio sistema de codificación, lo que generaba incompatibilidades. ASCII resolvió este problema, permitiendo que los diferentes dispositivos intercambiaran datos de manera eficiente.

En su formato original, ASCII utilizaba 7 bits para representar cada carácter, lo que permitía 128 combinaciones posibles (de 0 a 127). Esto incluía letras, números, signos de puntuación y caracteres de control. Posteriormente, con el tiempo, se añadieron los 8 bits a ASCII, lo que permitió el uso de 256 valores diferentes y su extensión en sistemas como ASCII extendido.

Estructura del Código ASCII

1. Caracteres de Control (0-31)

Los primeros 32 valores en el código ASCII están reservados para caracteres de control. Estos caracteres no representan letras o números visibles, sino que sirven para controlar la transmisión de datos. Algunos de los caracteres de control más importantes incluyen:

- 0 (NULL): Representa el final de una cadena de texto o el término de una secuencia de datos.

- 7 (BEL): Emite un sonido (bip).

- 8 (BS): Retroceso del cursor.

- 13 (CR): Retorno de carro (inicio de una nueva línea).

Estos caracteres se usaban originalmente para controlar impresoras y otros dispositivos de salida.

2. Caracteres Imprimibles (32-126)

Los valores del 32 al 126 en ASCII representan caracteres imprimibles. Esto incluye:

- Espacio (32): El carácter de espacio.

- Letras Mayúsculas y Minúsculas (65-90 para mayúsculas y 97-122 para minúsculas): Las letras del alfabeto inglés, tanto en mayúsculas como en minúsculas.

- Números (48-57): Los números del 0 al 9.

- Símbolos de puntuación y otros caracteres especiales (33-47, 58-64, 91-96, 123-126): Como los signos de exclamación, comas, puntos, paréntesis, y otros.

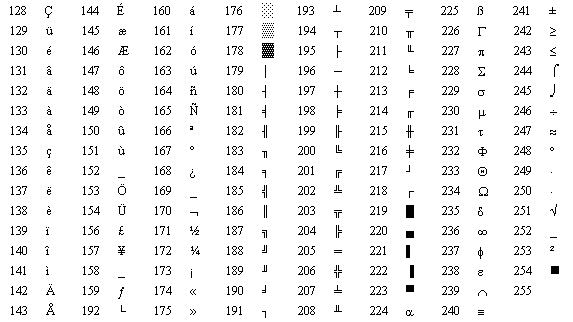

3. Caracteres Extendidos (128-255)

El ASCII extendido usa 8 bits, lo que permite codificar 256 caracteres en total. Los caracteres del 128 al 255 incluyen símbolos adicionales, como:

- Letras con acentos y caracteres especiales para otros idiomas.

- Símbolos gráficos y matemáticos.

- Letras griegas, caracteres monetarios (como el símbolo del euro), entre otros.

Este conjunto ampliado es comúnmente utilizado para representar caracteres en lenguajes que no se limitan al alfabeto inglés, como el español, francés o alemán.

¿Cómo se Representan los Caracteres en ASCII?

Cada carácter en ASCII se representa mediante un número binario de 7 o 8 bits. Por ejemplo:

- La letra A en ASCII tiene el valor 65, que en binario es 01000001.

- El número 3 tiene el valor 51, que en binario es 00110011.

- El espacio tiene el valor 32, que en binario es 00100000.

Este sistema de codificación permite que los ordenadores comprendan y procesen caracteres a nivel digital, convirtiendo información textual en secuencias de bits.

Aplicaciones y Usos de ASCII

1. Comunicación entre Dispositivos

Desde sus inicios, uno de los usos principales de ASCII ha sido facilitar la comunicación entre dispositivos electrónicos. Los sistemas que utilizan ASCII pueden intercambiar datos de manera eficiente y sin ambigüedades, lo que es fundamental en la computación y la telecomunicación.

2. Codificación de Archivos de Texto

Los archivos de texto simples, como los archivos .txt, generalmente se codifican utilizando ASCII o alguna de sus variantes. Esto permite que los textos sean fácilmente leídos por diferentes sistemas operativos y aplicaciones.

3. Programación

En programación, ASCII se utiliza para manipular caracteres y realizar operaciones sobre ellos. Muchos lenguajes de programación tienen funciones que permiten convertir un carácter a su correspondiente valor ASCII, y viceversa. También se emplea para crear representaciones de texto legibles por humanos o para estructurar datos.

Ejemplo en Python:

# Convertir un carácter a su código ASCII caracter = 'A' codigo_ascii = ord(caracter) print(f"El código ASCII de {caracter} es {codigo_ascii}")

Ejemplo en Java:

// Convertir un carácter a su código ASCII char caracter = 'A'; int codigo_ascii = (int) caracter; System.out.println("El código ASCII de " + caracter + " es " + codigo_ascii);

4. Web y HTML

En el desarrollo web, ASCII se utiliza en la codificación de caracteres especiales, como los símbolos de moneda, flechas, y caracteres no alfabéticos. Las entidades HTML, por ejemplo, están basadas en códigos ASCII y permiten representar caracteres especiales en una página web.

Limitaciones de ASCII

Aunque ASCII fue revolucionario en su época, hoy en día presenta ciertas limitaciones. El principal inconveniente es que solo es capaz de representar caracteres del alfabeto inglés y algunos símbolos básicos. Esto hace que no sea adecuado para idiomas que requieren caracteres adicionales (como acentos, letras especiales, etc.).

Para resolver este problema, se desarrollaron sistemas como Unicode, que permite representar una gama mucho más amplia de caracteres, abarcando casi todos los sistemas de escritura utilizados en el mundo.

Conclusión

El sistema ASCII ha sido un pilar fundamental en la historia de la computación, y aunque ha sido superado por sistemas más completos como Unicode, sigue siendo ampliamente utilizado en muchas aplicaciones. Su simplicidad y eficacia para representar caracteres en una forma comprensible para las máquinas lo convierten en una herramienta crucial en la programación y en la gestión de datos textuales.

Si deseas profundizar más en los códigos ASCII y cómo se utilizan, te recomendamos visitar recursos especializados como Computer Hope, donde podrás obtener información más detallada sobre este tema.